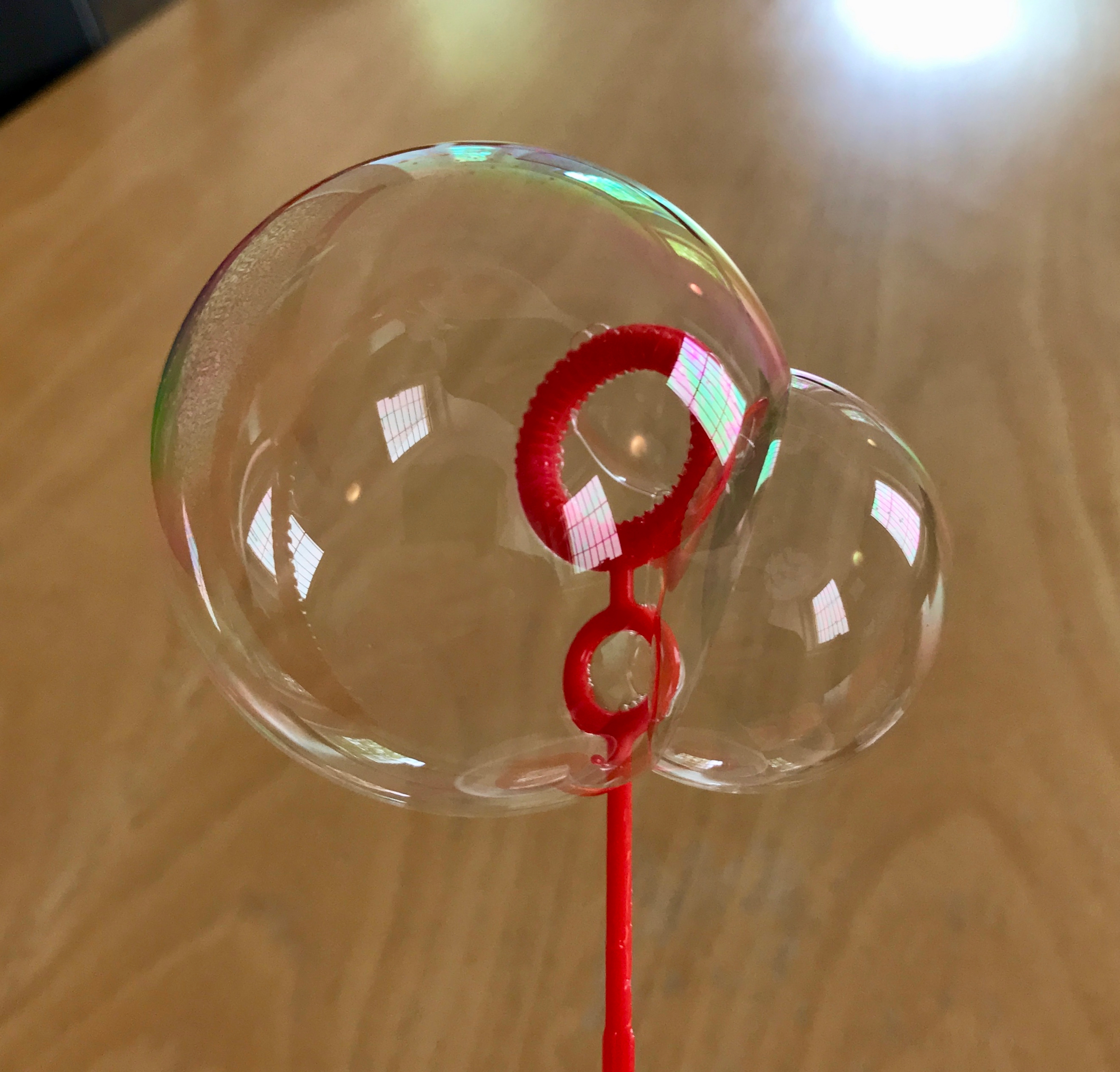

Jedes Kind mag Seifenblasen. Bunt schillernd schweben diese filigranen Gebilde fast schwerelos durch die Luft, einzig allein der Kontakt mit festen Objekten geht in der Regel nicht gut für sie aus. Ähnlich sieht es bei den vielen Filter Bubbles im Internet aus: So farbig sich die digitalen Wohlfühlzonen auf den ersten Blick auch darstellen, geben sie doch nur ein verzerrtes Bild der unterschiedlichen Online-Realitäten wieder.

„Ich mach‘ mir die Welt, wie sie mir gefällt“, sang bereits Pippi Langstrumpf lange Zeit vor dem Internet. Heutzutage ist es eher anders herum: Die digitale Welt präsentiert sich jedem so, wie es den Algorithmen gefällt – egal ob beim Online-Shopping, Surfen im Web oder Lesen von Newsfeeds in den Social Media. Dass daraus nicht automatisch qualitativ hochwertige Ergebnisse entstehen, diese Erfahrung hat jeder bereits gemacht. Es reicht beispielsweise ein Blick auf die Empfehlungen, die nach einer Suche im Katalog oder erfolgtem Kauf bei Online-Versandhändlern per Mail eintrudeln. Da tauchen ähnliche Artikel zu dem auf, den man gerade erworben hat – aber gut, selbst Waschmaschinen kann man ja nie genug haben 😉

So ein Algorithmus hat es aber auch nicht leicht. Das gilt insbesondere dann, wenn etwa ein Account für die Einkäufe mehrerer Familienmitglieder benutzt wird – vor diesem Spagat kapituliert die beste künstliche Intelligenz! Aber mal ehrlich, warum sollte ich es ihr auch leicht machen? Wenn ich einen neuen Twitter-Account nur für Cat-Content aufsetze und Menschen oder Bots folge, die diesen bereitstellen, kann ich die über Cookies generierte und dazu passende Werbung ja getrost ignorieren oder über einen AdBlocker erst gar nicht anzeigen lassen.

Kritisch wird es dann, wenn sich nicht nur die Werbung am einzelnen Anwender ausrichtet, sondern das auch bei den Inhalten passiert. Es ist keine große Kunst, ein bestimmtes Thema samt passendem Hashtag auf Twitter in die Trending Topics zu schieben. Ein aktuelles Beispiel auf dieser Plattform aus dem April ist die #NichtohnemeinKopftuch-Kampagne, welche es bis auf den dritten Platz schaffte: Von 77.000 Tweets dazu stammten 78 Prozent aus einem von Experten als islamistisch eingeordneten Umfeld (Quelle: Bayerischer Rundfunk). Der Skandal bei Facebook um die Weitergabe von mehr als 87 Millionen Nutzerdaten an die Analysefirma Cambridge Analytica wirft weitere Fragen auf, für welche Inhalte und wen diese Informationen verwendet wurden. Gerade wer, wie Facebook, Klarnamen bei der Registrierung fordert, muss auch Transparenz bieten.

Bei User-generated Content ist es nicht einfach, echte von Fake News zu unterscheiden – zumal dann, wenn die Kontrollmechanismen der Social-Media-Betreiber Defizite aufweisen oder erst gar nicht vorhanden sind. Bewegt ein aktuelles Thema wirklich viele Menschen oder wurde da künstlich (mehr oder weniger intelligent) nachgeholfen? Es ist notwendig, sich des jeweiligen Themas journalistisch und mit gesundem Menschenverstand zu nähern: Kann das überhaupt stimmen, was da steht? Welche – vom Ersteller abgesehen – weitere unabhängige Quellen gibt es dazu? Bietet das Thema nur eine einseitige Sicht, ohne die Gegenseite zu beachten? Falls die Antworten darauf „Nein“, „Keine“ oder „Ja“ lauten, erübrigt sich ein Klick auf den Retweet- oder Gefällt mir-Button. Dadurch wird diese Filter-Bubble nicht weiter mit Luft gefüllt, sie platzt eher früher als später von alleine.